deha magazine / DX / IFS CloudにおけるMigration Jobsの実践

IFS CloudにおけるMigration Jobsの実践

2026/04/19

概要

IFS Cloud におけるMigration Job(マイグレーションジョーブ)は、カットオーバーフェーズにおける最重要ボトルネックである。本稿では、実プロジェクトから抽出した知見をもとに、ステージングアーキテクチャ・トランザクション管理・冪等性設計・大容量データ処理・自動アラートの5領域にわたる実践的設計手法とトラブルシューティング戦略を体系的に解説する。適切に設計されたマイグレーションは単なるデータ移送を超え、監査可能性と再現性を備えた運用基盤となる。

アーキテクチャとデータフロー設計

大量データ移行における安定性と可観測性を確保するため、IFS CloudのMigration Job(マイグレーションジョーブ)は非同期・フェーズ分割型アーキテクチャに基づいて設計される必要がある。

1.1 コンポーネント間の関係

マイグレーションの全体像は、外部データファイルを起点に、IFSキューを経由して Oracle DB へ書き込むパイプラインとして把握できる。各フェーズは独立してモニタリング・リトライが可能な構造とすること。

1.2 データライフサイクル:生データから精製データへ

標準データフローは以下の3コアステップで構成される。

- ステージング生成 → バリデーション → 本番適用(Apply)

| 処理ステップ | 説明・ポイント |

| CREATE_TABLE_FROM_FILE | 生データを格納するステージングテーブルを作成。既存テーブルが存在する場合は _BKP サフィックスで自動バックアップされる。 |

| VALIDATE_ONLY | フォーマットチェック・ルックアップ照合・業務ルール検証を本番適用前に実施。エラー件数を事前に把握できる。 |

| MIGRATE_SOURCE_DATA | ステージング各行を処理し、New__ / Modify__ API 経由で各論理ユニット(LU)へレコードを登録する。 |

| Error Report | エラー行を IC_ROW_NO で記録し、安全な再実行(Re-run)を実現する。 |

ステージング戦略とマッピング最適化

2.1 ファイル取込モードの選択

ファイル取込方式の誤選択は、パフォーマンス全体に致命的な影響を与える。各モードの特性を正しく理解して選択すること。

| 取込モード | 特性と推奨用途 |

| OnClient | クライアントマシンから読込。容量・エンコーディングに厳しい制限あり。数MB未満の検証用小規模ファイルにのみ使用可。 |

| OnServer | Oracle UTL_FILE を使用。高速だがエンコーディング対応が限定的。中規模データ向け。 |

| OnServer — EXTTABLE Active(★推奨) | Oracle External Table を活用。最高速かつ UTF-8/マルチバイト完全対応。大容量データに必須。テナントに CREATE DIRECTORY 権限が必要。 |

2.2 マッピング設計における落とし穴

自動マッピング機能は利便性が高い反面、100% 信頼することは危険である。以下の点を必ず手動で確認すること。

⚠ 重大な落とし穴:動的属性列(A% columns)

動的属性列(A% columns)は IFS によって自動マッピングされない。手動追加を怠ると、実行時に深刻なデータ欠損が発生する。

必須確認チェックリスト:

- デフォルト値の設定漏れ

- ルックアップキーの整合性

- スコープ列(Company、Site 等)の正確なマッピング

- 勘定科目関連フィールド(優先コード・コストセンター等)の確認

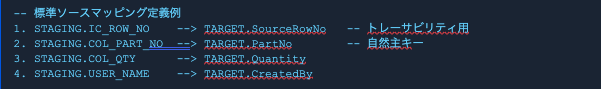

標準ソースマッピング定義例

トランザクション管理と冪等性設計

3.1 冪等性の実装

絶対に避けるべきアンチパターン:ターゲットテーブルを全削除してから再実行する設計。これは本番環境では許容されない。

冪等性を担保する設計原則:

- 自然キー(Natural Keys)の活用:既存レコードをシステムが識別できるようにする。

- バッチ単位の監査:ADDOBJID ルールと MAPDBCOL を組み合わせ、MIGRATE_SOURCE_DATA が処理済み行をスキップまたは正確な Object ID で更新できるようにする。

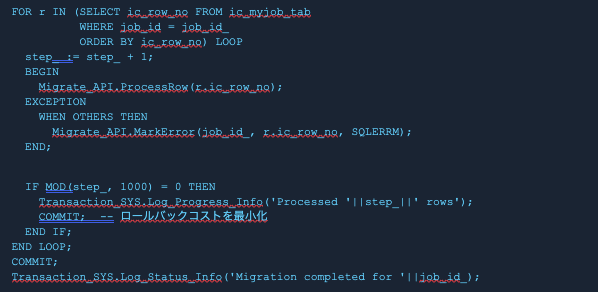

3.2 PL/SQL トランザクション制御

カスタムロジック API を実装する場合、トランザクション粒度の設計が極めて重要となる。コミット粒度が大きすぎるとメモリ圧迫を招き、小さすぎると I/O ボトルネックが発生する。

チャンクコミット実装例(1,000行ごとにコミット)

💡 ベストプラクティス

SAVEJOBDAYS ルールを必ず有効化し、バッチ状態と監査テーブルを保持すること。障害発生時の迅速な復旧に不可欠である。

パフォーマンスチューニングとトラブルシューティング

数百万件規模のレコードを処理する場合、MIGRATE_SOURCE_DATA はデフォルトでマルチスレッド実行されない点に注意が必要である。

4.1 大容量データ処理戦略

- ファイル分割(Chunking):Company・Site・日付軸でファイルを分割し、行ロックの競合を防止する。

- 並列実行(Parallel):複数の独立したジョブをキューに投入する。ただし、過度な並列数より DB サーバーの CPU スケールアップを優先すること。

4.2 トラブルシューティング・プレイブック

| 障害パターン | 対処手順 |

| ポイズンロウ(データ不良行) | ジョブを Continue モードで継続実行 → Data Steward がステージングを直接修正 → Resume で再開 |

| マッピング設定エラー(大量失敗) | Error Report でエラー内容を確認 → マッピング設定を修正 → ADDOBJID を有効化 → ジョブを安全に再起動 |

| 接続断(Connection Loss) | SAVEJOBDAYS が有効であることを確認 → ログ復旧 → ジョブを再実行(コミット済みチャンクはスキップされる) |

モニタリングと自動アラート

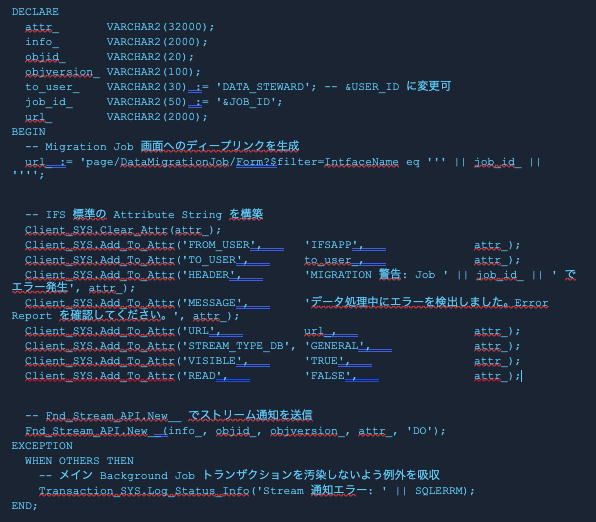

管理者が Background Jobs 画面を常時監視する運用は非効率かつリスクが高い。IFS のイベント機能を活用し、エラー発生時に Streams 経由で自動通知を送信する設計がベストプラクティスである。

5.1 実装手順(マイグレーション コードへの変更不要)

- IFS Aurena の Events 画面を開く。BackgroundJob 論理ユニット(テーブル:BACKGROUND_JOB_TAB)に対してカスタムイベントを作成し、State 列が Error または Warning に遷移した際にトリガーされるよう条件を設定する。

- 作成したイベントに対して Event Action を追加し、Action Type として Execute Online SQL を選択する。

自動アラート送信 PL/SQL(Fnd_Stream_API 利用例)

💡 設計上の利点

データ処理ロジックとアラートロジックを完全に分離することで、保守性が向上し、アラートの有効・無効を UI から即座に切り替えられる。

セキュリティと CI/CD

マイグレーションは本番 DB への深い介入を伴う操作であり、セキュリティと変更管理の徹底が不可欠である。

| 領域 | 実施事項 |

| ファイル取込セキュリティ(OWASP) | ランディングゾーンへのファイル形式・サイズ制限を設け、アンチウイルススキャンを必ず実施する。 |

| 権限管理(RBAC) | マイグレーションロールを付与された SysAdmin および Data Steward のみが実行権限を持つ。すべての操作は created_by・import_by フィールドで監査記録する。 |

| CI/CD とロールバック計画 | Migration Job (まいぐれーしょんジョッブ)設定を IFS の ACP/Script バージョン管理システムに格納する。batch_id 単位のデータパージツールを事前に準備し、Oracle Flashback Logs をロールバックの「プランB」として常備する。 |

まとめ

IFS Cloud におけるデータマイグレーションは、リソースを大量に消費するリスクの高いプロセスである。ステージング機構の深い理解、トランザクション制御の精密な設計、ポイズンロウへの対応シナリオの事前準備、そして自動アラートシステムの整備が、Go-Live の成否を左右する。

本稿で解説した設計原則と実装パターンは、単発プロジェクトの成功にとどまらず、将来の移行プロジェクトに再利用可能な組織資産となる。実践的なアーキテクチャ設計への投資が、長期的なシステム信頼性を担保する。